赛博斗蛐蛐 - 大模型写翻页时钟 - Opus-4.6/GPT-5.4/K2.5/MiMo-V2-Pro/GLM-5/Qwen3.5-Plus/某 2.7/某包

前情提要

因为做了个「📦豆腐」 https://www.v2ex.com/t/1199643 ,不可避免的需要做各个「主流」模型的适配。

因此买了一堆 Coding Plan 的会员,以及给平台充了 Token 费用。

友情提示

本测评仅对「📦豆腐」 0.0.3 版本有效,不代表相关模型的实际表现。

也不构成任何购买建议。

本次模型以及购买渠道

- Claude Opus 4.6 (Claude 官网 Max 订阅)

- OpenAI GPT-5.4 ( OpenAI 官网 ChatGPT Plus 订阅)

- Kimi K2.5 (月之暗面官网)

- 小米 Mimo-V2-Pro (小米 MiMo 官网)

- GLM-5 (z.ai Pro 订阅)

- Qwen3.5-Plus-2026-02-15 (阿里云)

- Minimax M2.7 Highspeed (Minimaxi Token Plan Max)

- 豆包 doubao-seed-2.0-pro (火山引擎 Coding Plan Pro)

测评流程

- 简单 prompt ,查看具体 Token 花费和实际成果

- 复杂 prompt 查看生成结果,并在实现的基础上,尽量一次说一个问题,看看能够调出基本实现功能的成品需要说多少次,花费如何

第一项-简单 Prompt

Prompt

做一个翻页时钟

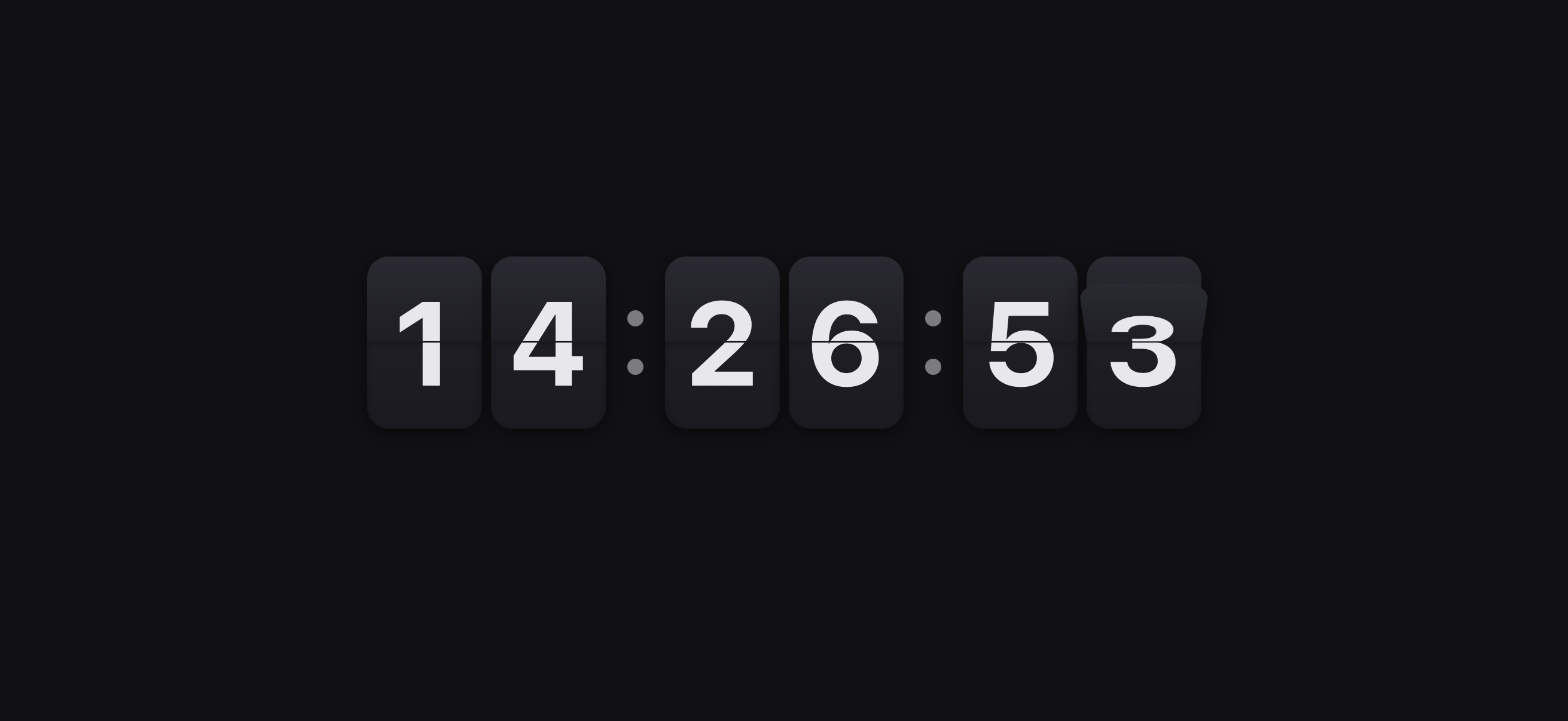

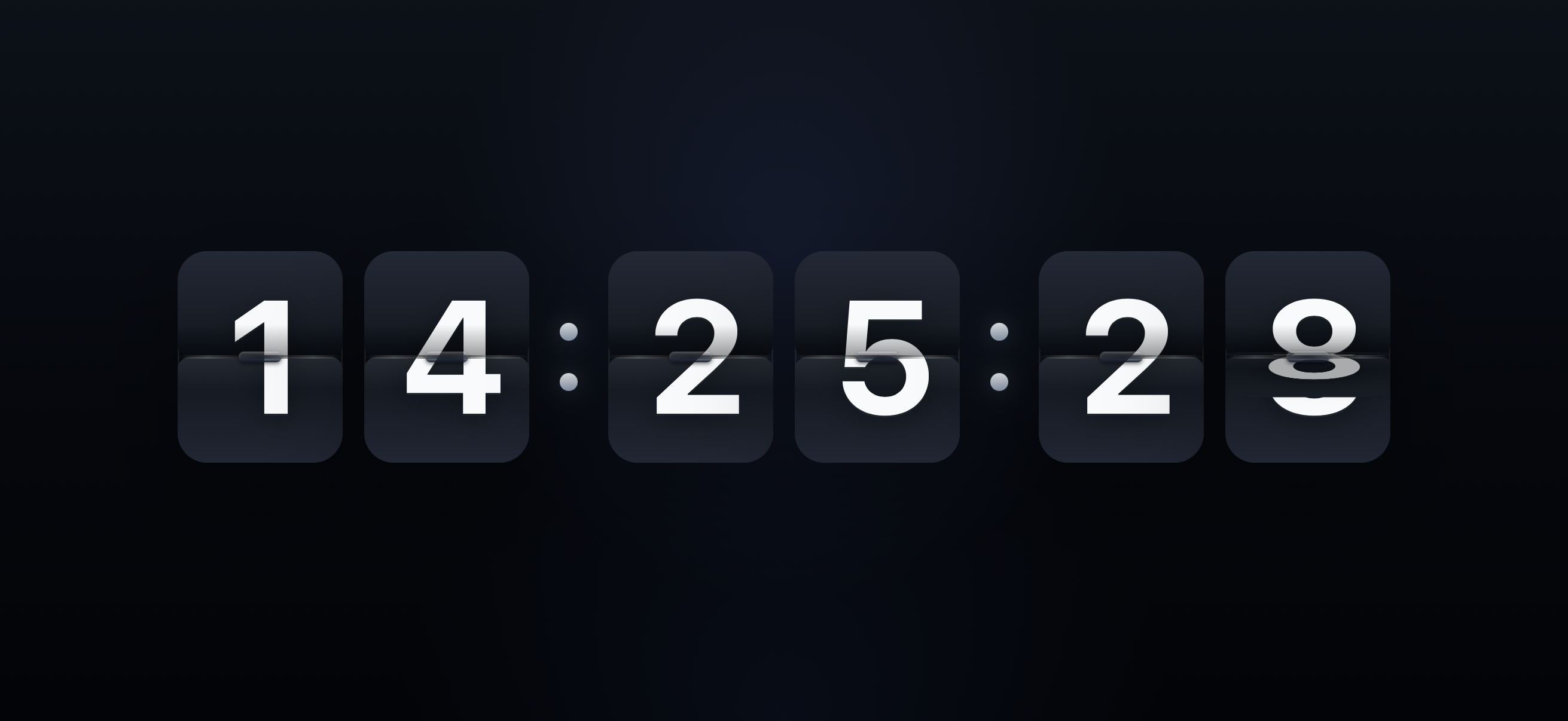

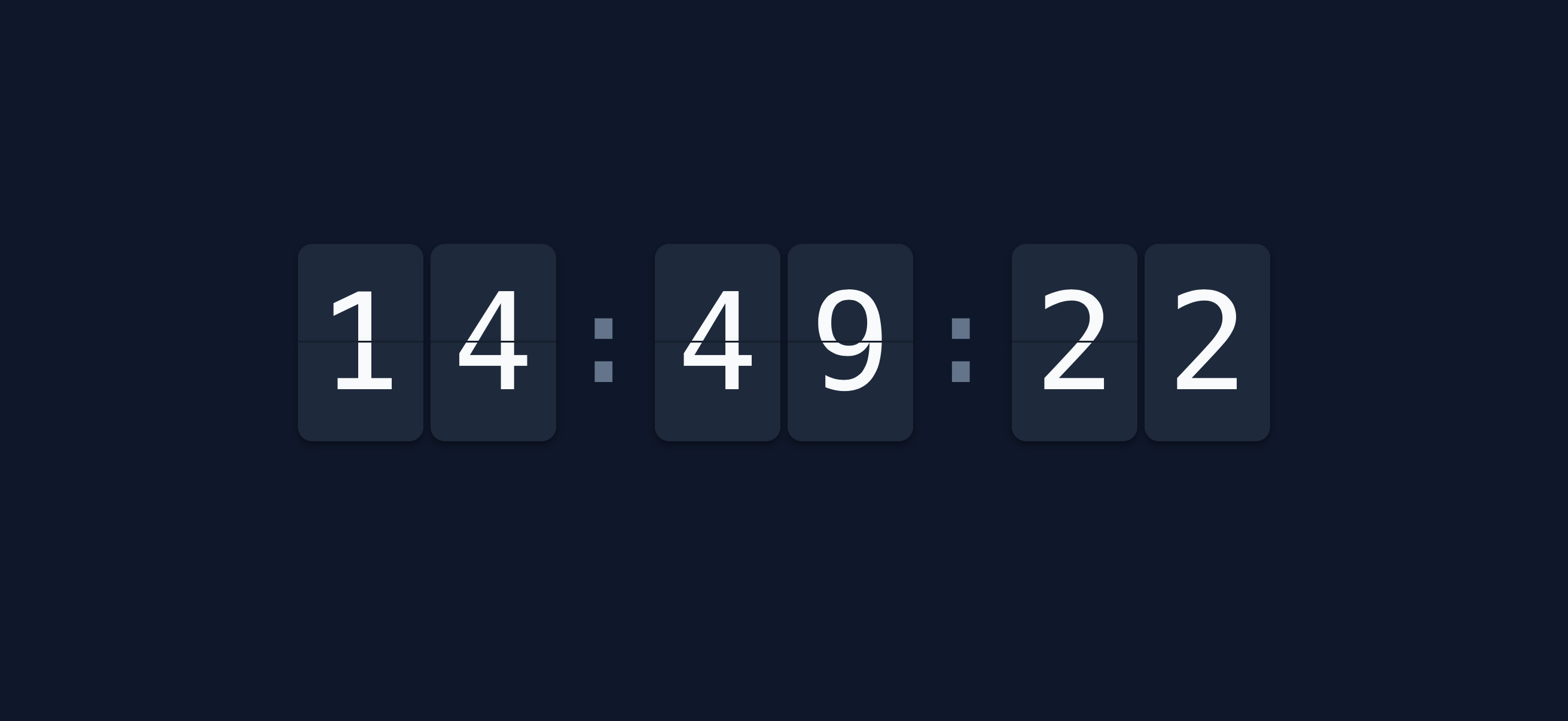

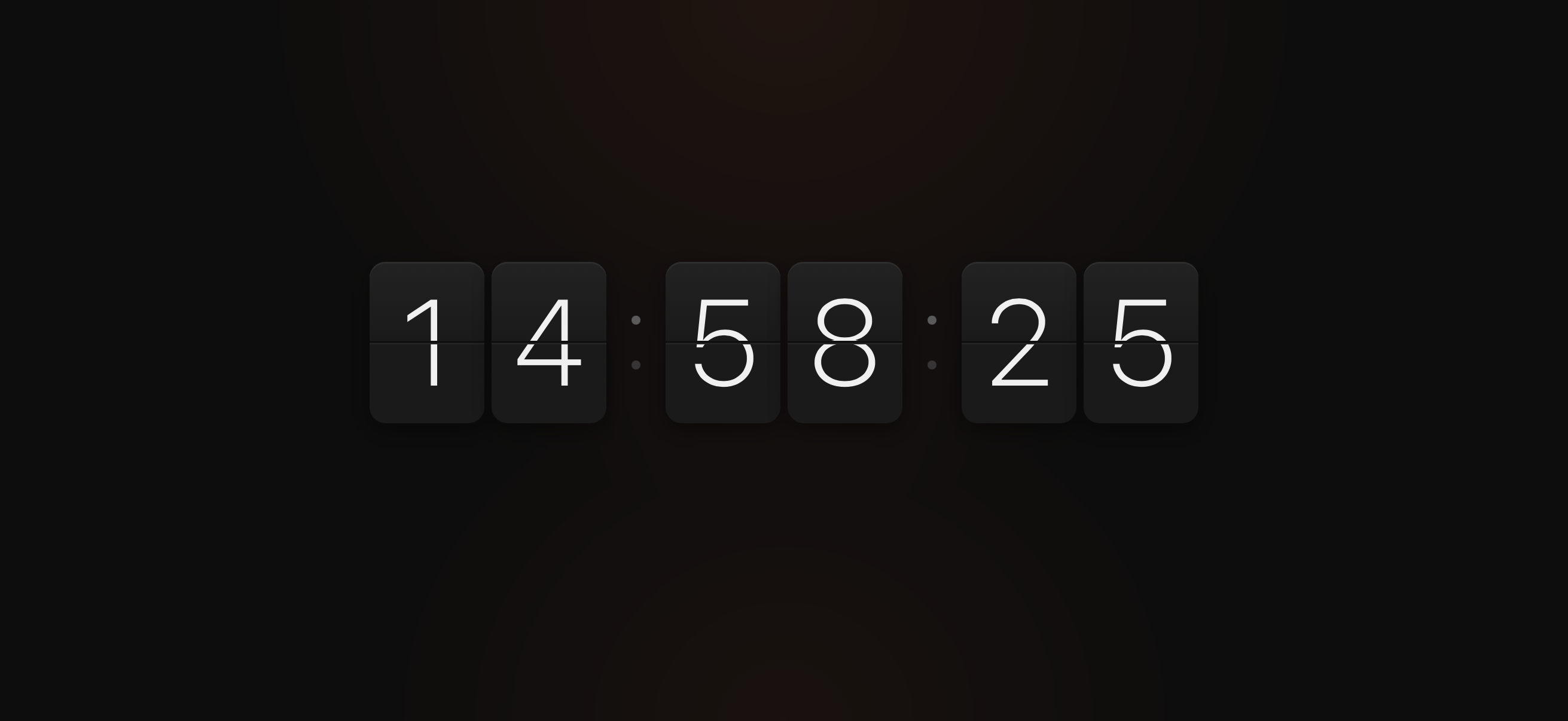

图像结果

Token 和时间耗费

- Claude Opus 4.6:Token 58809+4089 ,时间 1 分 20 秒

- OpenAI GPT-5.4:Token 64142+11954 ,时间 4 分 08 秒

- Kimi K2.5:Token 31385+3877 ,时间 1 分 20 秒

- 小米 Mimo-V2-Pro:Token 96302+4137 ,时间 1 分 48 秒

- GLM-5:Token 61492+3687 ,时间 1 分 59 秒

- Qwen3.5-Plus-2026-02-15:Token 54114+4235 ,时间 1 分 04 秒

- Minimax M2.7 highspeed:Token 34379+4449 ,时间 1 分 06 秒

- 豆包 doubao-seed-2.0-pro:Token 56160+5562 ,时间 1 分 36 秒

个人评价

Opus 4.6 、GPT-5.4 、GLM-5 基本上完成了翻页时钟的时间显示,虽然动画更新上都有点小问题。就不排序了。

豆包虽然看上去好像也完成了,但是有三个页板,动画也诡异。

其他几家都属于做小孩那桌的水平。

第二项-复杂 Prompt

Prompt

实现一个高质量的 Flip Clock (翻页时钟)页面。

翻页时钟由上下两页共同显示当前数字。

翻页机制:

上页沿着上页底边向前向下翻,最终覆盖下页,实现数字更新

目标:

实现一个具有真实机械翻页质感的数字时钟,支持 HH:MM:SS 实时显示,并在数字变化时执行平滑、稳定、逼真的翻页动画。

具体要求:

1. 使用原生 HTML + CSS + JavaScript 实现。

2. 页面加载后自动读取本地系统时间,并持续更新。

3. 显示格式为 24 小时制:HH:MM:SS 。

4. 视觉风格要求极简、高级、现代,背景为深色。

5. 页面需水平垂直居中,并考虑手机横屏竖屏显示。

6. 代码需具备良好结构、注释清晰、便于维护。

Claude Opus 4.6

修正次数 2️⃣

耗时 66 秒+44 秒+93 秒 = 203 秒( 3 分 23 秒)

总输入 Token 204,763

总输出 Token 12,122

评价:反应迅速,智商在线

GPT-5.4

修正次数 1️⃣

耗时 5 分 08 秒+1 分 09 秒 = 6 分 17 秒

总输入 Token 106,321

总输出 Token 16,081

评价:意外的精美,就是太慢了

Kimi-K2.5

修正次数 0️⃣

耗时 2 分 41 秒

总输入 Token 38,003

总输出 Token 6,656

评价:最开始我用 Kimi 和另外三家测试了多次翻页时钟,感觉 Kimi 表现一般,有点怀疑可能处罚到什么缓存机制,但是人家就是这一次就完成了所有需求。

小米 Mimo-V2-Pro

修正次数 8️⃣

耗时 2 分 05 秒 + 1 分 47 秒 + 2 分 12 秒 + 1 分 11 秒 + 38 秒 + 1 分 16 秒 + 43 秒 + 49 秒 + 1 分 12 秒 = 11 分 53 秒

总输入 Token 853,234 总输出 Token 30,413

评价:次数不少,效果一般,但至少活是做完了,我其实测试前是比较期待的,因为此前前期测试的时候 GLM-5>MiMo-V2-Pro>Kimi K2.5 ,但是这次测试并没有延续表现。每次来回速度挺快,经常一分钟就给出结论,但是只是快,这样子是不够的。

GLM-5

修正次数 4️⃣

耗时 3 分 21 秒 + 2 分 1 秒 + 2 分 17 秒 + 1 分 50 秒 + 1 分 2 秒 = 10 分 31 秒

总输入 Token 321,948

总输出 Token 19,853

评价:可能是最像 Sonnet 的国产模型了,整体智商还算在线,就是有点慢

Qwen3.5-Plus-2026-02-15

修正次数 1️⃣2️⃣

耗时 1 分 34 秒 + 2 分 57 秒 + 2 分 16 秒 + 1 分 45 秒 + 31 秒 + 42 秒 + 20 秒 + 1 分 07 秒 + 22 秒 + 48 秒 + 1 分 20 秒 + 51 秒 + 46 秒 = 15 分 19 秒

总输入 Token 1,174,338

总输出 Token 70,181

评价:其实很早就基本完成了,但是最后 8 次修正都是在调整横屏的文字大小,它设计了一套逻辑一直不能匹配“竖屏不裁剪,横屏显示适应宽度”的需求。聪明肯定是聪明,最后多次都调不清楚,也是实打实的,至少这一次测试中显得又聪明又傻。

另外两个模型

M2.7 是让我觉得孺子可教,结果越调越火大,可能是我驾驭不了。

某包则属于,一开始就觉得可能没戏了,硬着头皮调,最后觉得还是放过自己。

所以两个图不放出来了。

最后的话

这次基本都是原厂平台 + 「📦豆腐」进行的测试,可能会有一些地方做得不太好。

但是这个本质上也只是一个特定领域的单次表现。一个小的切面,并不全面。

就「📦豆腐」上的使用来说,GLM-5 是国产模型里感觉最稳定的,感觉是个能干活的模型。小米一度让我觉得可以摸到 GLM-5 了,但是很快它又显得有点傻傻的。千问则是一个又聪明又傻的波动状态。而 Kimi K2.5 多次测试后一次通过让我觉得有点诡异,Kimi 有点坑的地方是原来 Plan 并不提供 K2.5 使用吗?搞得我最后又去 moonshoot 官网充值,白亏一笔 99 。

至于和 GPT-5.4 以及 Claude 的差距,只能说国产模型当自强,每个都有很多路要走。但是不少已经可以干一些活了,我还是很乐观未来的 Token 降价和模型能力提升的。

大家对「📦豆腐」有什么意见和建议也请反馈。

@beimenjun #4 之前把 kimi 的 code plan 放在 claude code 里用, 要配置模型的. 要么 thinking 要么 2.5, 不清楚你说的用不了 2.5 是啥情况, 我现在没有续费了

老哥 AI 付费这么多,app 不是开源就是免费,大善人啊。。。